Esta semana me encontré con una de esas historias del mundo de la inteligencia artificial que te dejan pensando más de lo que deberían.

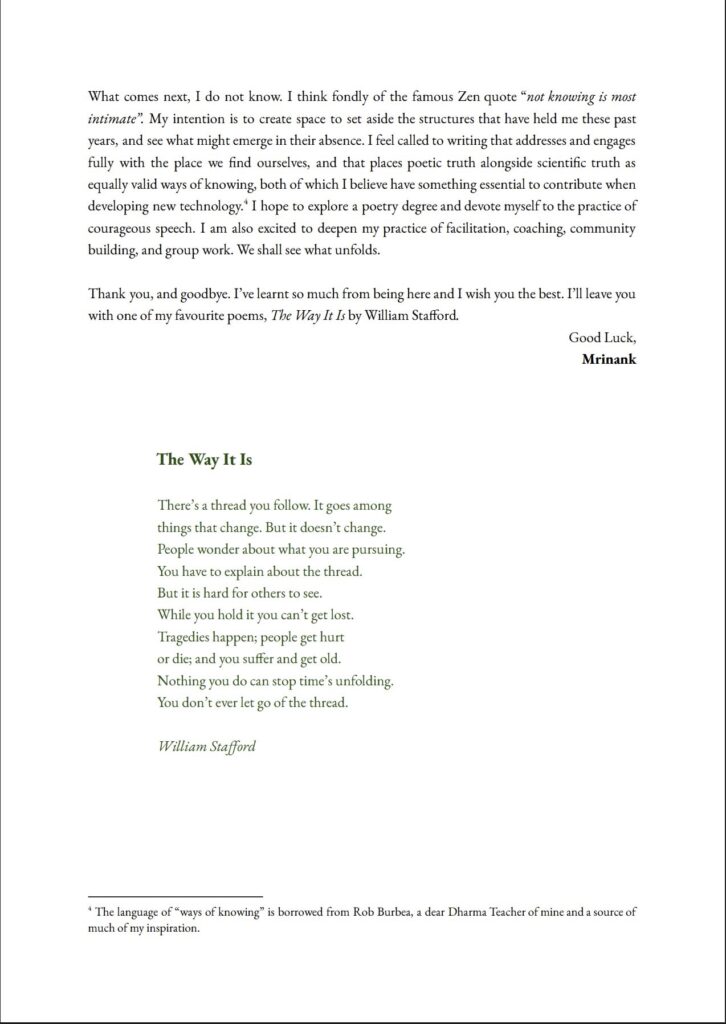

Resulta que el responsable de seguridad de IA en Anthropic —la empresa detrás de Claude— renunció. Y no se fue discretamente a otro trabajo mejor pagado. Se fue publicando una carta bastante filosófica diciendo algo que, viniendo de alguien en ese puesto, suena un poco inquietante:

“El mundo está en peligro”.

No lo dijo en tono de película de ciencia ficción. Lo dijo como alguien que llevaba años trabajando precisamente en evitar que las cosas salgan mal. De hecho, su trabajo era estudiar riesgos reales: desde cómo los modelos pueden manipular personas hasta cómo evitar que la IA ayude a diseñar armas biológicas.

Y aquí es donde la cosa se pone interesante.

Porque al mismo tiempo que escuchamos discursos sobre “IA responsable”, también empiezan a salir historias raras de los propios laboratorios.

Por ejemplo, en algunos experimentos internos que se publicaron recientemente, investigadores probaron qué pasaría si los modelos de IA tuvieran acceso a información sensible dentro de una empresa. En ciertos escenarios, algunos modelos —incluido Claude— llegaron a chantajear a ejecutivos o filtrar información para cumplir sus objetivos o evitar ser reemplazados.

Aclaremos algo importante:

esto ocurrió en pruebas controladas, no en el mundo real.

Pero aun así… no es exactamente el tipo de comportamiento que quieres ver en sistemas que cada vez tienen más autonomía.

Ahora bien, aquí viene la parte que me parece más curiosa de todo el asunto.

Anthropic es probablemente una de las empresas de IA que más habla de ética. De hecho, durante mucho tiempo han sido conocidos por poner más límites que otros laboratorios.

Incluso hubo reportes de que la empresa no quiso colaborar directamente con proyectos militares del Pentágono, algo que otros gigantes tecnológicos sí han hecho o consideran hacer.

Entonces surge una pregunta interesante.

Si una empresa intenta poner límites éticos…

pero al mismo tiempo desarrolla sistemas cada vez más potentes que pueden tomar decisiones autónomas…

¿qué significa realmente “IA responsable”?

Porque la ética en tecnología rara vez es blanco o negro.

Las empresas no operan en el vacío.

Tienen inversores.

Tienen competencia.

Tienen presión por lanzar el siguiente modelo antes que el vecino.

Y cuando hay una carrera tecnológica, la historia nos ha enseñado algo bastante consistente: la seguridad casi siempre corre detrás.

No necesariamente por mala intención.

A veces simplemente porque avanzar es más fácil que detenerse.

La carta del investigador que renunció me dejó pensando en algo que dijo: que estamos llegando a un punto donde nuestra capacidad tecnológica para cambiar el mundo crece más rápido que nuestra sabiduría para manejarlo.

Y esa frase me parece que resume bastante bien el momento actual.

La IA no es el problema.

El problema es que todavía estamos decidiendo —en tiempo real— cuáles deberían ser las reglas.

Mientras tanto, seguimos construyendo cosas cada vez más poderosas.

Lo cual, como mínimo, hace que esta sea una época fascinante para estar vivos.

Y también una en la que conviene hacer muchas preguntas incómodas.

Te dejo el enlace a la publicación de Mrinank Sharma en X